В современном мире финансовых технологий обучение с подкреплением (Reinforcement Learning, RL) становится одним из наиболее перспективных подходов к автоматизации инвестиционных решений. В отличие от традиционных методов машинного обучения, которые требуют размеченных данных, агенты обучения с подкреплением учатся оптимальным стратегиям через непосредственное взаимодействие с рыночной средой, получая награды или штрафы за свои действия.

Эта парадигма особенно привлекательна для задач распределения активов, где решения должны приниматься последовательно во времени, а результаты действий проявляются с задержкой. Агентные системы способны адаптироваться к изменяющимся рыночным режимам без явного перепрограммирования, что делает их мощным инструментом в арсенале современного финансового аналитика.

Основы обучения с подкреплением в финансах

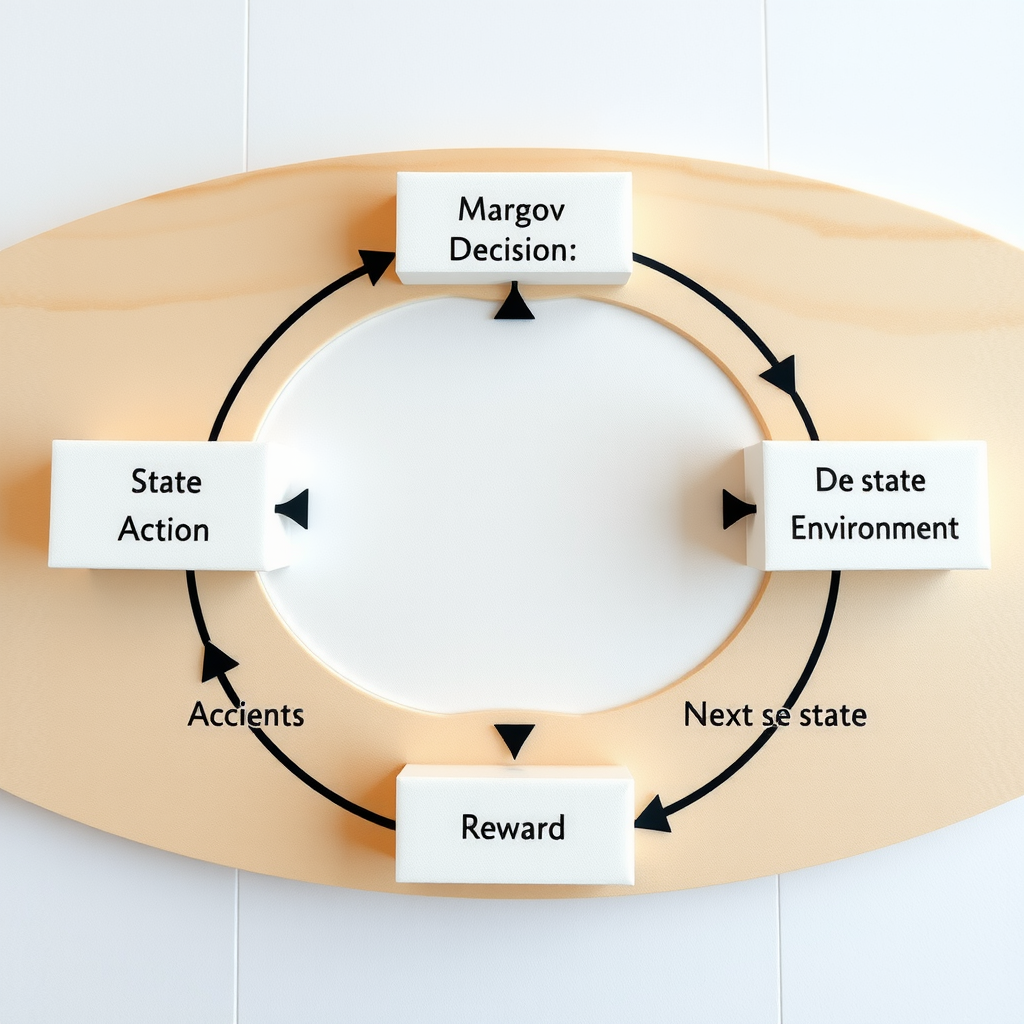

Обучение с подкреплением представляет собой класс алгоритмов машинного обучения, где агент обучается принимать решения путем взаимодействия со средой. В контексте финансовых рынков агент наблюдает текущее состояние рынка (цены активов, объемы торгов, технические индикаторы), выбирает действие (покупка, продажа или удержание активов), и получает награду (прибыль или убыток от сделки).

Ключевая цель агента — максимизировать кумулятивную награду на протяжении времени, что в финансовом контексте означает максимизацию доходности портфеля с учетом риска. Этот процесс формализуется через марковский процесс принятия решений (Markov Decision Process, MDP), где будущее состояние зависит только от текущего состояния и выбранного действия, а не от всей истории предыдущих состояний.

Компоненты системы обучения с подкреплением

Любая система обучения с подкреплением для финансовых приложений состоит из нескольких ключевых компонентов:

- Пространство состояний— набор всех возможных наблюдений, которые агент может получить от рынка. Это могут быть исторические цены, технические индикаторы, макроэкономические данные, текущие позиции портфеля.

- Пространство действий— множество всех возможных решений, которые агент может принять. Для задачи распределения активов это обычно веса активов в портфеле или изменения этих весов.

- Функция награды— математическая формула, определяющая качество принятого решения. Обычно включает доходность портфеля, скорректированную на риск и транзакционные издержки.

- Политика— стратегия агента, определяющая, какое действие выбрать в каждом состоянии. Может быть детерминированной или стохастической.

- Функция ценности— оценка ожидаемой кумулятивной награды из данного состояния при следовании определенной политике.

Важное замечание:Правильный выбор пространства состояний и функции награды критически важен для успеха системы. Слишком простое представление состояния может не захватить важные рыночные паттерны, в то время как слишком сложное приведет к проблеме "проклятия размерности" и замедлит обучение.

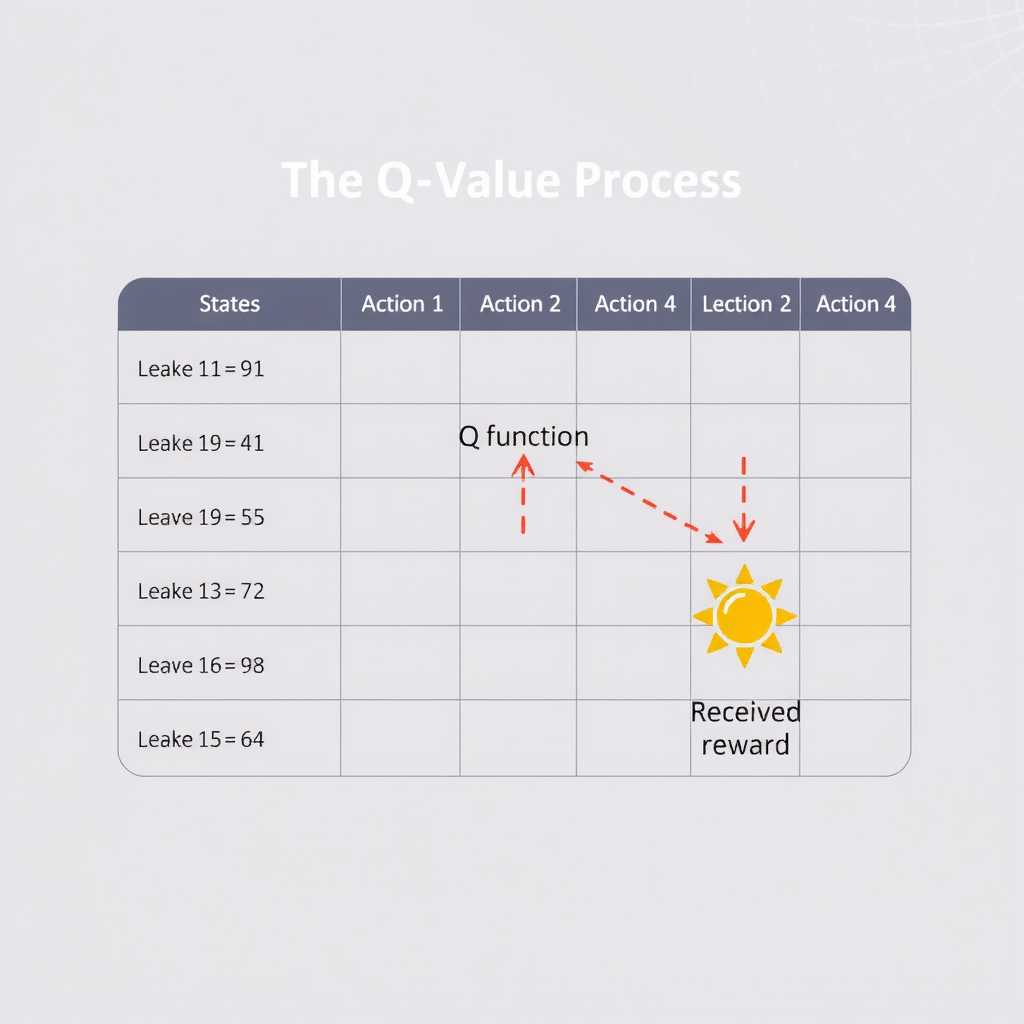

Q-обучение для управления портфелем

Q-обучение является одним из фундаментальных алгоритмов обучения с подкреплением, который оценивает качество пар "состояние-действие" через Q-функцию. Эта функция представляет ожидаемую кумулятивную награду при выборе определенного действия в данном состоянии и последующем следовании оптимальной политике.

В контексте распределения активов Q-функция помогает агенту оценить, насколько выгодно будет изменить веса портфеля определенным образом в текущей рыночной ситуации. Алгоритм итеративно обновляет оценки Q-значений на основе полученного опыта, постепенно приближаясь к оптимальной стратегии.

Глубокое Q-обучение (DQN) для сложных портфелей

Классическое табличное Q-обучение сталкивается с серьезными ограничениями при работе с непрерывными пространствами состояний и действий, характерными для реальных финансовых рынков. Глубокое Q-обучение (Deep Q-Network, DQN) решает эту проблему, используя глубокие нейронные сети для аппроксимации Q-функции.

В DQN нейронная сеть принимает на вход представление рыночного состояния (например, нормализованные цены активов за последние N дней) и выдает Q-значения для всех возможных действий. Сеть обучается минимизировать разницу между предсказанными Q-значениями и целевыми значениями, вычисленными на основе уравнения Беллмана.

Ключевые инновации DQN, критически важные для стабильности обучения в финансовых приложениях:

- Буфер воспроизведения опыта— хранит историю взаимодействий агента с рынком и позволяет обучаться на случайных выборках из этой истории, разрушая временные корреляции в данных.

- Целевая сеть— отдельная копия Q-сети, параметры которой обновляются реже, что стабилизирует целевые значения при обучении.

- Обрезка градиентов— ограничивает величину обновлений весов сети, предотвращая катастрофическое забывание при резких изменениях рынка.

Практический совет:При применении DQN к реальным финансовым данным критически важно правильно нормализовать входные признаки и использовать достаточно большой буфер воспроизведения (минимум 10,000 переходов) для обеспечения разнообразия обучающих примеров.

Методы градиента политики для непрерывного управления

В то время как Q-обучение оценивает ценность действий, методы градиента политики напрямую оптимизируют параметры политики агента. Это особенно полезно для задач с непрерывными пространствами действий, таких как определение точных весов активов в портфеле.

Основная идея заключается в том, чтобы параметризовать политику (обычно нейронной сетью) и использовать градиентный подъем для максимизации ожидаемой награды. Градиент вычисляется на основе траекторий, собранных агентом при взаимодействии с рынком, что позволяет системе учиться на собственном опыте.

Алгоритм REINFORCE и его модификации

REINFORCE — базовый алгоритм градиента политики, который обновляет параметры политики пропорционально полученной награде. Для каждой траектории (последовательности состояний, действий и наград) алгоритм вычисляет градиент логарифма вероятности выбранных действий, взвешенный кумулятивной наградой.

Однако классический REINFORCE страдает от высокой дисперсии оценок градиента, что приводит к нестабильному обучению. Для решения этой проблемы используются несколько техник:

- Базовая линия (baseline)— вычитание из награды некоторого базового значения (например, средней награды) для уменьшения дисперсии без внесения смещения в оценку градиента.

- Advantage функция— использование разности между Q-функцией и функцией ценности состояния, что показывает, насколько действие лучше среднего в данном состоянии.

- Обобщенная оценка преимущества (GAE)— экспоненциально взвешенное среднее временных разностей, балансирующее между смещением и дисперсией оценок.

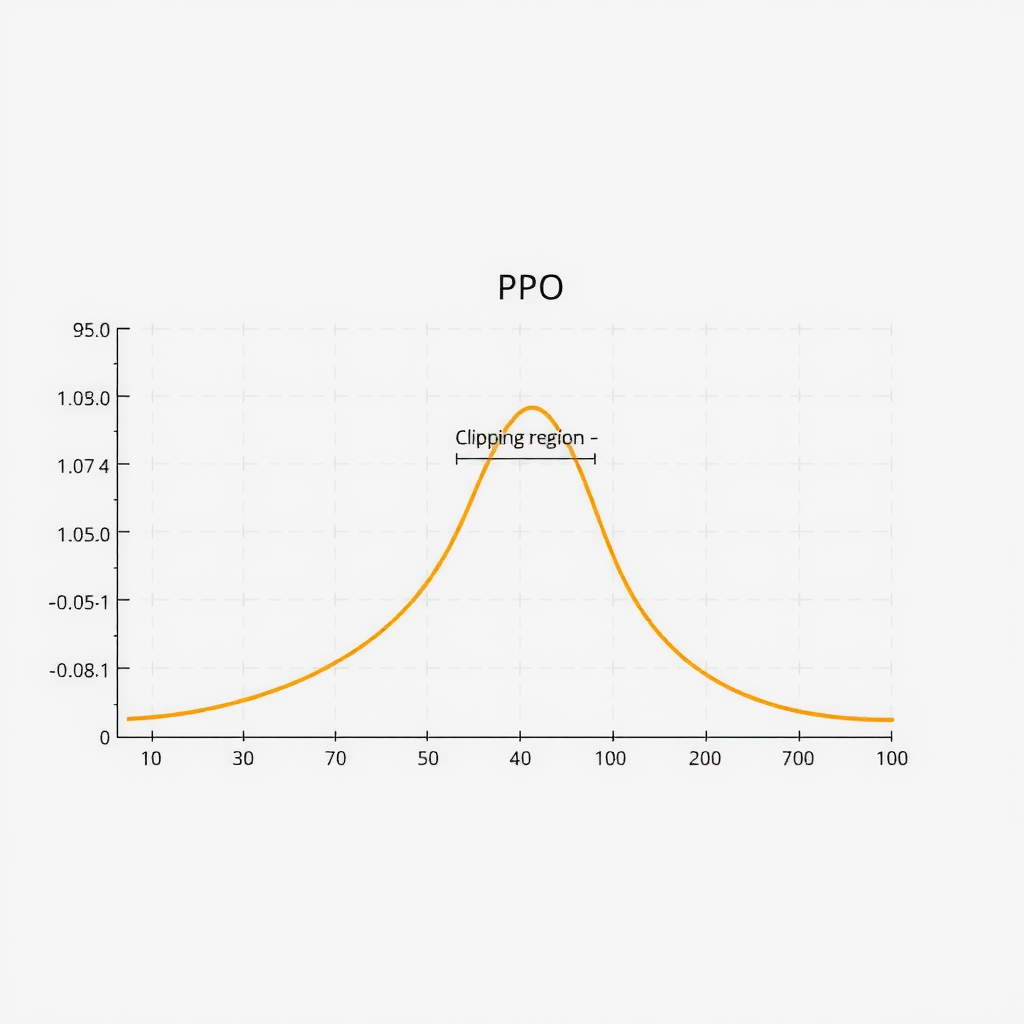

Proximal Policy Optimization (PPO)

PPO представляет собой современный алгоритм градиента политики, который стал стандартом де-факто для многих приложений обучения с подкреплением благодаря своей стабильности и эффективности. Ключевая идея PPO — ограничить величину обновления политики на каждом шаге, чтобы избежать катастрофически плохих обновлений.

Это достигается через специальную функцию потерь, которая обрезает отношение вероятностей новой и старой политик, если оно выходит за пределы заданного диапазона (обычно [0.8, 1.2]). Такой подход гарантирует, что агент не будет делать слишком резких изменений в своей стратегии, что особенно важно в волатильной финансовой среде.

Преимущества PPO для финансов:Алгоритм демонстрирует отличную стабильность при обучении на нестационарных финансовых данных, требует меньше гиперпараметров для настройки по сравнению с другими методами, и эффективно использует собранные данные благодаря возможности многократного обновления на одном батче траекторий.

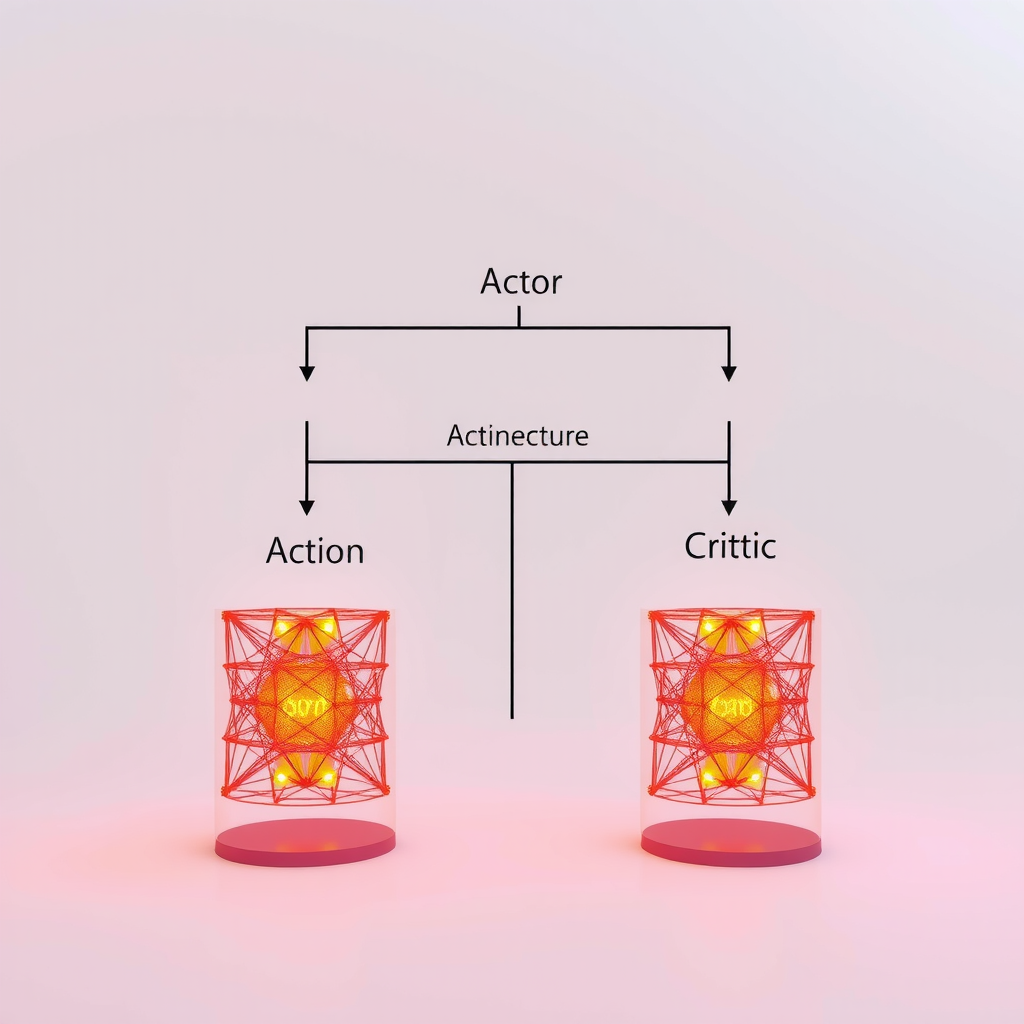

Архитектуры актор-критик для мультиактивных портфелей

Методы актор-критик объединяют преимущества Q-обучения и градиента политики, используя две нейронные сети: актор, который определяет политику агента, и критик, который оценивает качество выбранных действий. Эта архитектура особенно эффективна для задач с большими пространствами состояний и действий, характерных для управления мультиактивными портфелями.

Актор обучается максимизировать ожидаемую награду, используя градиенты, предоставленные критиком. Критик, в свою очередь, обучается предсказывать функцию ценности или Q-функцию, используя временные разности. Такое разделение ответственности позволяет системе эффективно обучаться даже в сложных рыночных условиях.

Deep Deterministic Policy Gradient (DDPG)

DDPG — это алгоритм актор-критик, специально разработанный для непрерывных пространств действий. Он использует детерминированную политику (актор), которая напрямую выдает действие для каждого состояния, и Q-функцию (критик), которая оценивает это действие.

Для задачи распределения активов DDPG особенно привлекателен, так как может напрямую выдавать веса портфеля как непрерывные значения. Алгоритм использует несколько ключевых техник:

- Целевые сети— как для актора, так и для критика, обновляемые через мягкое обновление (soft update) для стабильности обучения.

- Буфер воспроизведения— для разрушения временных корреляций в финансовых данных.

- Шум исследования— добавление шума Орнштейна-Уленбека к действиям актора для обеспечения исследования пространства действий.

Twin Delayed DDPG (TD3)

TD3 представляет собой улучшенную версию DDPG, которая решает проблему переоценки Q-значений через три ключевые модификации. Во-первых, используются два критика вместо одного, и для обновления актора берется минимум из их оценок. Во-вторых, актор обновляется реже, чем критики (обычно раз в два обновления критиков). В-третьих, к целевым действиям добавляется шум для сглаживания Q-функции.

Эти модификации делают TD3 более стабильным и надежным для финансовых приложений, где переоценка потенциальной прибыли может привести к чрезмерно рискованным стратегиям. Алгоритм демонстрирует отличную производительность на задачах с высокой размерностью пространства действий, таких как управление портфелями из десятков активов.

Проектирование функции награды для финансовых агентов

Функция награды является критическим компонентом любой системы обучения с подкреплением, определяющим, какое поведение агента считается желательным. В финансовом контексте проектирование функции награды требует тщательного баланса между несколькими конкурирующими целями: максимизацией доходности, минимизацией риска, учетом транзакционных издержек и обеспечением диверсификации.

Компоненты функции награды

Типичная функция награды для задачи распределения активов включает следующие компоненты:

- Доходность портфеля— основной компонент, обычно вычисляемый как процентное изменение стоимости портфеля за период.

- Штраф за риск— может быть реализован через волатильность доходности, максимальную просадку или Value-at-Risk (VaR).

- Транзакционные издержки— штраф за изменение весов портфеля, пропорциональный объему торгов.

- Штраф за концентрацию— поощрение диверсификации через штраф за слишком большие веса отдельных активов.

- Штраф за бездействие— опциональный компонент, стимулирующий агента активно управлять портфелем.

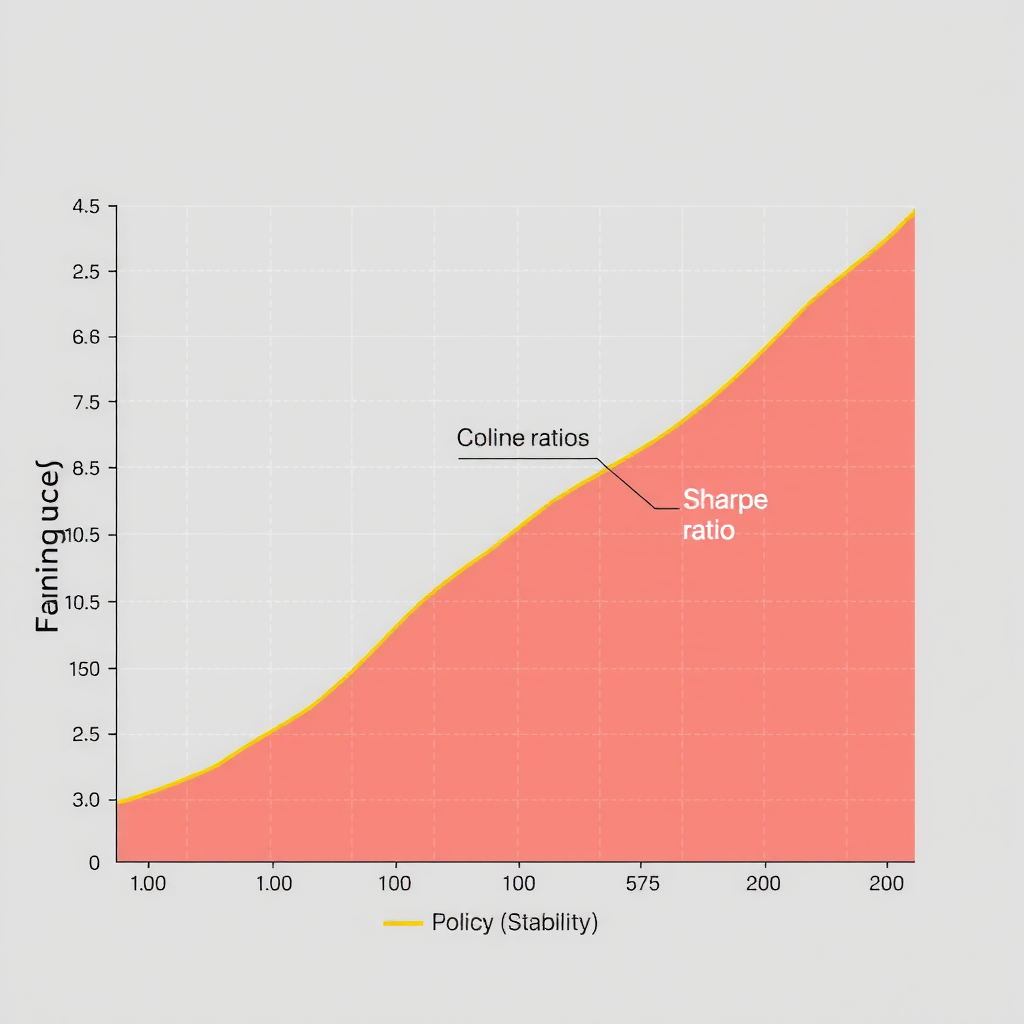

Формула Шарпа как награда:Один из популярных подходов — использовать коэффициент Шарпа (отношение избыточной доходности к волатильности) в качестве функции награды. Это естественным образом балансирует доходность и риск, хотя требует накопления достаточной истории для надежной оценки волатильности.

Проблемы разреженных наград

Одна из ключевых проблем в применении обучения с подкреплением к финансам — разреженность наград. Если награда выдается только в конце торгового периода (например, раз в месяц), агенту сложно понять, какие именно действия привели к хорошему или плохому результату. Это замедляет обучение и может привести к субоптимальным стратегиям.

Для решения этой проблемы используются несколько подходов:

- Формирование наград (reward shaping)— добавление промежуточных наград, которые направляют агента к желаемому поведению.

- Иерархическое обучение— разбиение задачи на подзадачи с более частыми наградами.

- Имитационное обучение— предварительное обучение на демонстрациях экспертных стратегий.

Баланс исследования и эксплуатации

Одна из фундаментальных дилемм обучения с подкреплением — баланс между исследованием (exploration) новых стратегий и эксплуатацией (exploitation) уже известных хороших стратегий. В финансовом контексте это особенно критично, так как чрезмерное исследование может привести к значительным убыткам, в то время как недостаточное исследование не позволит агенту адаптироваться к изменяющимся рыночным условиям.

Стратегии исследования

Существует несколько подходов к организации исследования в финансовых агентах:

- Epsilon-жадная стратегия— с вероятностью epsilon агент выбирает случайное действие, иначе — лучшее известное действие. Epsilon обычно уменьшается со временем.

- Шум в пространстве параметров— добавление шума к весам нейронной сети политики, что приводит к более согласованному исследованию.

- Энтропийная регуляризация— добавление энтропии политики к функции награды, поощряя более стохастическое поведение.

- Любопытство (curiosity)— дополнительная награда за посещение новых или редких состояний.

Адаптивное исследование

Для финансовых приложений особенно важно адаптировать уровень исследования к текущим рыночным условиям. В периоды высокой волатильности или структурных изменений рынка может быть полезно увеличить исследование, чтобы найти новые эффективные стратегии. В стабильные периоды можно сосредоточиться на эксплуатации проверенных подходов.

Один из подходов — использовать метрики неопределенности модели (например, дисперсию предсказаний ансамбля сетей) для динамической настройки уровня исследования. Высокая неопределенность сигнализирует о необходимости больше исследовать, в то время как низкая неопределенность позволяет уверенно эксплуатировать текущую политику.

Адаптация к изменяющимся рыночным режимам

Финансовые рынки нестационарны — их статистические свойства меняются со временем. Это создает серьезную проблему для агентов обучения с подкреплением, которые могут переобучиться на исторических данных и плохо работать в новых условиях. Способность адаптироваться к изменяющимся режимам без явного вмешательства человека является ключевым преимуществом подхода обучения с подкреплением.

Онлайн-обучение и непрерывная адаптация

Одна из стратегий адаптации — непрерывное онлайн-обучение, где агент постоянно обновляет свою политику на основе новых рыночных данных. Это позволяет системе постепенно адаптироваться к изменениям, не забывая полностью предыдущий опыт.

Однако онлайн-обучение требует осторожности, чтобы избежать катастрофического забывания — ситуации, когда агент полностью забывает ранее изученные стратегии при обучении на новых данных. Для решения этой проблемы используются техники, такие как:

- Эластичная консолидация весов (EWC)— добавление штрафа за изменение важных параметров сети.

- Прогрессивные нейронные сети— добавление новых нейронов для обучения новым режимам при сохранении старых.

- Буфер воспроизведения с приоритизацией— сохранение и периодическое воспроизведение важных исторических примеров.

Мета-обучение для быстрой адаптации

Мета-обучение (learning to learn) — это подход, при котором агент обучается быстро адаптироваться к новым задачам или условиям на основе небольшого количества новых данных. В финансовом контексте это означает обучение агента, который может быстро настроиться на новый рыночный режим, наблюдая лишь несколько дней новых данных.

Алгоритмы мета-обучения, такие как Model-Agnostic Meta-Learning (MAML), обучают начальные параметры модели таким образом, чтобы несколько шагов градиентного спуска на новой задаче приводили к хорошей производительности. Это особенно полезно для финансовых агентов, которым нужно быстро адаптироваться к внезапным изменениям рынка, таким как кризисы или структурные сдвиги.

Практические вызовы и ограничения

Несмотря на теоретическую привлекательность обучения с подкреплением для финансовых приложений, существует ряд практических вызовов, которые необходимо учитывать при разработке реальных систем.

Проблема симуляции и реальности

Агенты обучения с подкреплением обычно обучаются в симулированной среде, которая может не полностью отражать сложность реальных рынков. Проскальзывание (slippage), задержки исполнения, влияние собственных сделок на рынок, изменения ликвидности — все эти факторы сложно точно смоделировать, но они критически важны для реальной торговли.

Для смягчения этой проблемы рекомендуется:

- Использовать консервативные оценки транзакционных издержек в симуляции

- Включать реалистичные модели проскальзывания и задержек

- Тестировать агента на исторических данных с различными рыночными условиями

- Начинать с малых объемов при переходе к реальной торговле

- Постоянно мониторить расхождения между симуляцией и реальностью

Требования к вычислительным ресурсам

Обучение глубоких нейронных сетей для обучения с подкреплением требует значительных вычислительных ресурсов, особенно для сложных архитектур и больших пространств состояний. Это может быть барьером для небольших организаций или индивидуальных трейдеров.

Однако существуют стратегии оптимизации:

- Использование более простых архитектур сетей для начальных экспериментов

- Применение техник дистилляции знаний для сжатия обученных моделей

- Параллелизация сбора данных через множество симулированных сред

- Использование облачных вычислительных ресурсов для обучения

- Инкрементальное обучение вместо полного переобучения

Интерпретируемость и доверие

Глубокие нейронные сети, используемые в современных алгоритмах обучения с подкреплением, часто являются "черными ящиками", что затрудняет понимание причин принятия тех или иных решений. Это создает проблемы с доверием и регуляторным соответствием в финансовой индустрии.

Для повышения интерпретируемости можно использовать:

- Методы визуализации активаций нейронной сети

- Анализ важности признаков через градиенты

- Дистилляцию сложных моделей в более простые, интерпретируемые правила

- Логирование и анализ траекторий принятия решений

- Сравнение с традиционными, понятными стратегиями

Заключение и будущие направления

Обучение с подкреплением представляет собой мощный инструмент для автоматизации принятия инвестиционных решений, способный адаптироваться к изменяющимся рыночным условиям без явного перепрограммирования. Алгоритмы Q-обучения, градиента политики и актор-критик предоставляют разнообразный набор подходов для решения задачи распределения активов, каждый со своими преимуществами и ограничениями.

Ключевые выводы из нашего исследования:

- Правильное проектирование функции награды критически важно для успеха системы и требует тщательного баланса между доходностью, риском и транзакционными издержками.

- Баланс исследования и эксплуатации должен адаптироваться к текущим рыночным условиям для оптимальной производительности.

- Способность адаптироваться к изменяющимся рыночным режимам является ключевым преимуществом подхода обучения с подкреплением перед статическими стратегиями.

- Практические вызовы, такие как разрыв между симуляцией и реальностью, требуют осторожного подхода при переходе к реальной торговле.

Будущие направления исследований включают разработку более эффективных методов мета-обучения для быстрой адаптации, улучшение интерпретируемости моделей для соответствия регуляторным требованиям, и интеграцию альтернативных источников данных (новости, социальные сети, макроэкономические индикаторы) для более полного понимания рыночного контекста.

По мере развития вычислительных мощностей и алгоритмов машинного обучения, обучение с подкреплением будет играть все более важную роль в финансовой индустрии, предоставляя инвесторам мощные инструменты для навигации в сложной и постоянно меняющейся рыночной среде.